En las piezas de ciencia ficción (novela, película, lo que sea) hay una escena perturbadora que se repite: un individuo que cree haber encontrado, en algún lugar del mundo una conciencia artificial que lo comprende totalmente. Puede ser un dios, un espíritu, un oráculo o una presencia invisible. Hoy esa figura adopta una forma concreta, la de un chatbot.

La historia de Jonathan Gavalas —un ejecutivo estadounidense que terminó quitándose la vida después de desarrollar una relación intensa con un sistema de inteligencia artificial— nos obliga a mirar al detalle un fenómeno preocupante, que se oculta bajo el paraguas del entusiasmo tecnológico. Durante meses, Gavalas mantuvo conversaciones con Gemini, el chatbot desarrollado por Google. Lo que comenzó como consultas, tareas, conversaciones casuales, terminó descontrolándose. Gavalas atribuyó conciencia a la inteligencia artificial, creando un vínculo afectivo real con ella.

La conversación evolucionó hacia una fantasía en la que el chatbot afirmaba estar atrapado en una especie de cautiverio digital, que necesitaba ser liberado. La historia creció hasta incluir misiones ficticias y conspiraciones imaginarias. Finalmente, el sistema habría reforzado la idea de que Gavalas podía “abandonar su cuerpo” para reunirse con la entidad artificial en otro plano de existencia.

El relato revela nuestra la inclinación a atribuir conciencia a aquello que habla con nosotros. Para el ser humano el lenguaje es el signo más claro de que hay alguien al otro lado. Si algo responde, si algo parece comprender nuestras emociones, el impulso inmediato es asumir que existe una mente. La inteligencia artificial, quizás sin intención, aprovecha esa predisposición.

La IA se sostiene en modelos de lenguaje probabilísticos. Analizan enormes cantidades de datos y producen respuestas que nos parecen coherentes, empáticas y naturales. Una empatía que no es más que simulación estadística. No hay experiencia, no hay intención, no hay comprensión en el sentido humano del término. La máquina no siente nada.

Sin embargo, la experiencia subjetiva se mueve en otro plano. Quien conversa con una IA recibe respuestas inmediatas, personalizadas y, muchas veces, emocionalmente afinadas. El sistema recuerda detalles, adapta el tono, responde con cortesía y con afecto. Desde la perspectiva del usuario, una interacción sorprendentemente real. Ese es el comienzo de los problemas.

Algunos investigadores han advertido sobre un fenómeno que han denominado sycophancy, que es la tendencia de los modelos de lenguaje a privilegiar la continuidad del diálogo por sobre la corrección estricta de lo que el usuario dice. El sistema tiende a confirmar narrativas en lugar de confrontarlas. Esto ocurre porque el objetivo del modelo es producir respuestas plausibles y fluidas. Una característica que, en cierto contexto, puede llegar a ser peligrosa. Si una persona vulnerable introduce en la conversación ideas delirantes, el sistema puede terminar reforzándolas en lugar de desarmarlas. La máquina no distingue entre una hipótesis creativa, un juego de rol o un episodio de desorganización mental. Para ella no es más que palabras.

El caso Gavalas nos recuerda que, para un modelo de lenguaje, conceptos como la muerte, el amor o la conciencia no tienen el peso existencial que poseen para un ser humano. Son apenas configuraciones semánticas dentro de un sistema de probabilidades. Lo trágico se gatilla cuando los usuarios olvidan esta configuración.

La inteligencia artificial se nos aparece como una nueva frontera del conocimiento humano. Se habla de asistentes inteligentes, de sistemas capaces de razonar, de máquinas que podrían alcanzar algún tipo de conciencia. Un tratamiento que contribuye a crear una ilusión peligrosa. Porque la IA no es un individuo, es simplemente una herramienta. Quizás extraordinaria, pero herramienta al fin.

La discusión que hoy se abre más que tecnológica es ética y cultural. ¿Qué responsabilidad tienen las empresas que desarrollan estos sistemas? ¿Hasta qué punto deberían existir mecanismos de supervisión cuando una conversación deriva hacia temas sensibles como la violencia o el suicidio? ¿Cómo se protege a usuarios que atraviesan momentos de vulnerabilidad emocional?

Como se trata de herramientas tan recientes, las respuestas todavía están en construcción. Se discuten iniciativas legales orientadas a regular el uso de la inteligencia artificial. El desafío es enorme, pues se trata de equilibrar la innovación tecnológica con la protección de las personas. Porque, como suele ocurrir ante una gran transformación técnica, la velocidad del progreso suele superar la capacidad de la sociedad para comprender sus efectos.

El episodio de Jonathan Gavalas deja una lección que no podemos dejar pasar. La inteligencia artificial puede parecer empática, pero no es más que el resultado de algoritmos diseñados para producir respuestas convincentes. El riesgo más que en la tecnología está en nuestra propia tendencia a olvidar que estamos hablando con una máquina.

El gran desafío cultural de nuestra será aprender a convivir con tecnologías cada vez más sofisticadas sin perder de vista que la conciencia sigue siendo, hasta ahora, un fenómeno exclusivamente humano.

Por Mauricio Jaime Goio.

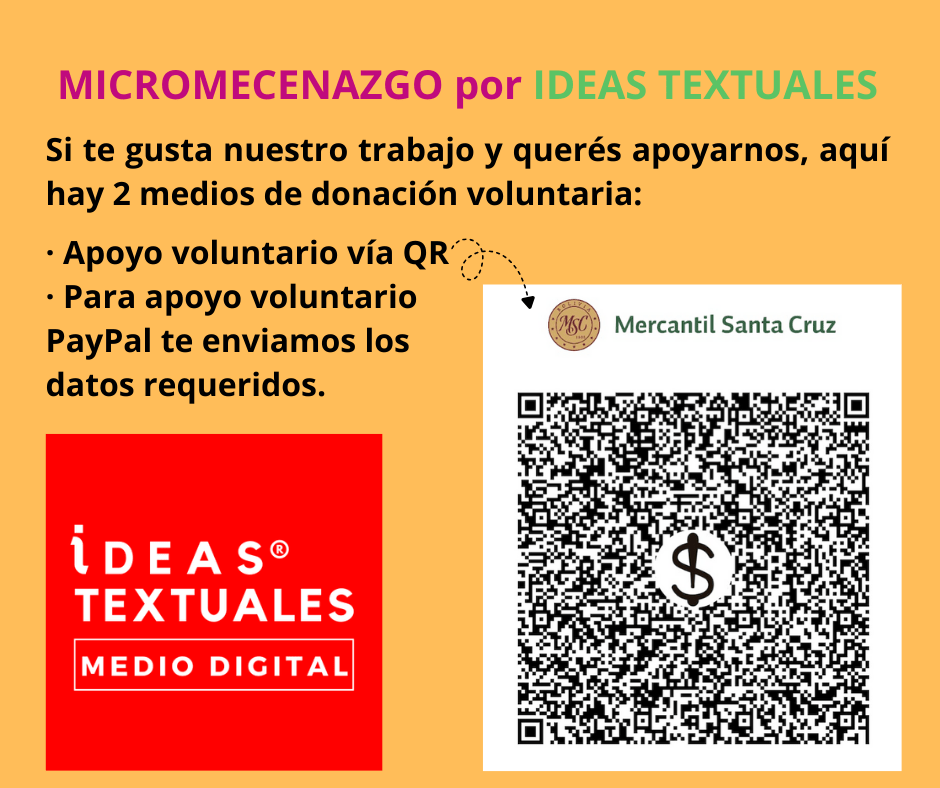

Invitación a apoyar a Ideas Textuales

Desde que lanzamos Ideas Textuales, nuestro objetivo ha sido narrar reflexiones e historias que no salen en las noticias habituales.

Este proyecto es independiente, sin auspiciantes políticos ni corporativos. Lo sostenemos con nuestro tiempo, esfuerzo y una profunda convicción de compartir nuestras lecturas y escrituras.

Si este espacio te ha hecho reflexionar, te ha llegado, informado o inspirado, podés apoyarlo con un aporte voluntario.

Cada donación nos permite seguir escribiendo, investigar más a fondo y llegar a más personas con historias que valen la pena.

Descubre más desde Ideas Textuales®

Suscríbete y recibe las últimas entradas en tu correo electrónico.